To jest stara wersja strony!

Laboratorium 6 - Sztuczne sieci neuronowe

Lista i opis plików

ex4.m - Skrypt pomagający przejść przez laboratorium

ex4data1.mat - Dane uczące zawierające pismo odręczne

ex4weights.mat - Parametry sieci neuronowej

displayData.m - funkcja wizualizująca zbiór danych

fmincg.m - Funkcja wyznaczająca minimum (podobna do fminunc)

sigmoid.m - funkcja sigmoidalna

computeNumericalGradient.m - Numerycznie oblicza gradienty

checkNNGradients.m - Funkcja sprawdzajaca gradienty

debugInitializeWeights.m - Funkcja inicjalizujaca wagi początkowe

predict.m - Funkcja predykcji dla sieci neuronowej

sigmoidGradient.m - Obliczanie gradientów dla funkcji sigmoidalnej

randInitializeWeights.m - Losowa inicjalizacja wag sieci neuronowej

nnCostFunction.m - funkcja kosztu dla sieci neuronowej

Wstęp

Celem ćwiczeń laboratoryjnych jest nauczenie sieci neuronowej rozpoznawania cyfr.

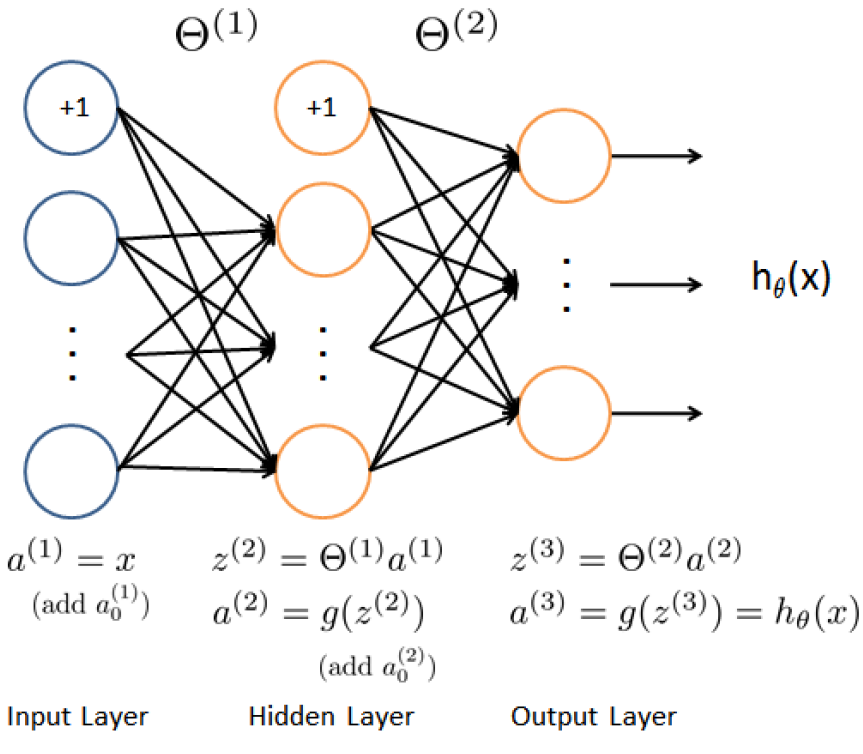

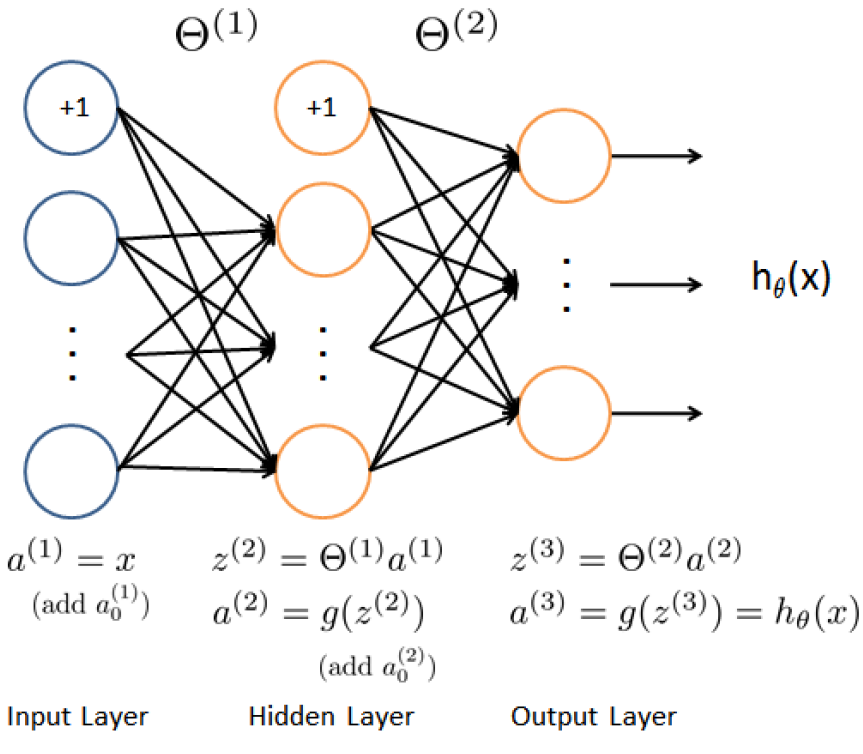

Sieć neuronowa będzie składać się z 3 warstw. Ilość neuronów w warstwie wyjściowej będzie równa ilości klasyfikowanych wzorców (czyli w naszym przypadku 10).

Struktura sieci neuronowej przedstawiona jest na rysunku poniżej. Pierwsza warstwa zawiera 400 perceptronów, warstwa ukryta zabiera 25 neuronów, a warstwa wyjściowa 10.

Funkcja kosztu

Uzupełnij plik nnCostFunction.m wyznaczając koszt i gradient dla sieci neuronowej.

Uwaga Macierz X, zawierająca zbiór uczący, zbudowana jest w taki sposób, że poszczególne elementy uczące znajdują się w wierszach. Aby dostać się do i-tego przykładu uczącego należy zatem odwołać się do niego w następujący sposób: X(i,:).

Uwaga Macierz X nie zawiera elementów biasu, dlatego w funkcji nnCostFunction.m konieczne jest dodanie tych elementów!

Uwaga Parametry  dla poszczególnych warstw sieci znajdują się w zmiennych Theta1 oraz Theta2. Theta1 ma rozmiar 25 x 401. Theta2 ma rozmiar 10 x 26.

dla poszczególnych warstw sieci znajdują się w zmiennych Theta1 oraz Theta2. Theta1 ma rozmiar 25 x 401. Theta2 ma rozmiar 10 x 26.

Wartość funkcji kosztu obliczany jest za pomocą wzoru:

![Equation $$J(\theta)= \frac{1}{m}\sum_{i=1}^{m}\sum_{k=1}^{K}\left [ -y_k^{(i)}log((h_\theta(x^{(i)}))_k)-(1-u_k^{(i)})log(1-(h_\theta(x^{(i)}))_k \right ]$$](/lib/exe/fetch.php?media=wiki:latex:/imgb85852ce64ca071675c0589d316a9436.png)

Gdzie  to ilość przykładów w zbiorze uczącym, a

to ilość przykładów w zbiorze uczącym, a  to ilość etykiet (w naszym przypadku 10).

to ilość etykiet (w naszym przypadku 10).

Uwaga Pamiętaj aby poprawnie obliczyć wartość  , która w przypadku sieci neuronowej polega na wymnożeniu współczynników wag Theta i danych wejściowych - zobacz rysunek powyżej.

, która w przypadku sieci neuronowej polega na wymnożeniu współczynników wag Theta i danych wejściowych - zobacz rysunek powyżej.

Uwaga Sieć neuronowa ma 10 neuronów w warstwie wyjściowej. Zatem wyjście sieci oznaczające, że rozpoznano np liczbę 3, będzie wyglądać następująco:

Sprawdź działanie funkcji za pomocą skrypty check.m.

Uruchom skrypt ex4.m. Powinieneś zobaczyć koszt równy około 0.287629.

Funkcja kosztu z regularyzacją

Wartość funkcji kosztu obliczany jest za pomocą wzoru:

![Equation $$

J(\theta)= \frac{1}{m}\sum_{i=1}^{m}\sum_{k=1}^{K}\left [ -y_k^{(i)}log((h_\theta(x^{(i)}))_k)-(1-u_k^{(i)})log(1-(h_\theta(x^{(i)}))_k \right ] + R(\theta)

$$](/lib/exe/fetch.php?media=wiki:latex:/img9dba4af4b2ee41f918d1ae16b838320f.png)

Gdzie

![Equation $$

R(\theta) = \frac{\lambda}{2m}\left [ \sum_{j=1}^{25}\sum_{k=1}^{400}(\Theta_{j,k}^{(1)})^2+\sum_{j=1}^{10}\sum_{k=1}^{25}(\Theta_{j,k}^{(2)})^2 \right ]

$$](/lib/exe/fetch.php?media=wiki:latex:/imgea4cbf53f7962a9feafc29737e1876dd.png)

Uwaga Pamiętaj, żeby we wzorze na remaskularyzację nie uwzględniać biasu.

Przetestuj działanie funkcji za pomocą skryptu check.m.

Przetestuj działanie funkcji za pomocą skryptu ex4.m. Powinieneś otrzymać wynik funkcji kosztu na poziomie około 0.383770.

Backpropagation

Dla każdego elementu t ze zbioru uczącego wykonaj następujące kroki (tutaj nie da się uniknąć pętli for t=1:m … end).

Dla każdego elementu t ze zbioru uczącego wykonaj następujące kroki (tutaj nie da się uniknąć pętli for t=1:m … end).

Ustaw wartości perceptronów (warstwa wejściowa

na

t-ty element ze zbioru uczącego

. Wykonaj propagacje wprzód (patrz

rysunek pierwszy), obliczając poszczególne wartości dla warstw wewnętrznych (

). Pamiętaj o uwzględnieniu biasu w zmiennych

oraz

. Np.

a_1 = [1; a_1].

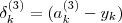

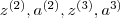

Dla każdego neuronu z warstwy wyjściowej oblicz

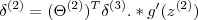

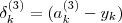

Dla ukrytej warstwy

, ustaw:

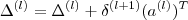

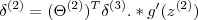

Oblicz zakumulowany gradient dla danego elementu

t. Pamiętaj żeby pominąć

:

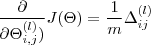

Wyznacz niezregularyzowany gradient:

Uruchom skrypt ex4.m i sprawdź poprawność działania algorytmu.

dla poszczególnych warstw sieci znajdują się w zmiennych Theta1 oraz Theta2. Theta1 ma rozmiar 25 x 401. Theta2 ma rozmiar 10 x 26.

dla poszczególnych warstw sieci znajdują się w zmiennych Theta1 oraz Theta2. Theta1 ma rozmiar 25 x 401. Theta2 ma rozmiar 10 x 26.

![Equation $$J(\theta)= \frac{1}{m}\sum_{i=1}^{m}\sum_{k=1}^{K}\left [ -y_k^{(i)}log((h_\theta(x^{(i)}))_k)-(1-u_k^{(i)})log(1-(h_\theta(x^{(i)}))_k \right ]$$](/lib/exe/fetch.php?media=wiki:latex:/imgb85852ce64ca071675c0589d316a9436.png)

to ilość przykładów w zbiorze uczącym, a

to ilość przykładów w zbiorze uczącym, a  to ilość etykiet (w naszym przypadku 10).

to ilość etykiet (w naszym przypadku 10).

, która w przypadku sieci neuronowej polega na wymnożeniu współczynników wag Theta i danych wejściowych - zobacz rysunek powyżej.

, która w przypadku sieci neuronowej polega na wymnożeniu współczynników wag Theta i danych wejściowych - zobacz rysunek powyżej.

![Equation $$

J(\theta)= \frac{1}{m}\sum_{i=1}^{m}\sum_{k=1}^{K}\left [ -y_k^{(i)}log((h_\theta(x^{(i)}))_k)-(1-u_k^{(i)})log(1-(h_\theta(x^{(i)}))_k \right ] + R(\theta)

$$](/lib/exe/fetch.php?media=wiki:latex:/img9dba4af4b2ee41f918d1ae16b838320f.png)

![Equation $$

R(\theta) = \frac{\lambda}{2m}\left [ \sum_{j=1}^{25}\sum_{k=1}^{400}(\Theta_{j,k}^{(1)})^2+\sum_{j=1}^{10}\sum_{k=1}^{25}(\Theta_{j,k}^{(2)})^2 \right ]

$$](/lib/exe/fetch.php?media=wiki:latex:/imgea4cbf53f7962a9feafc29737e1876dd.png)

na t-ty element ze zbioru uczącego

na t-ty element ze zbioru uczącego  . Wykonaj propagacje wprzód (patrz

. Wykonaj propagacje wprzód (patrz  ). Pamiętaj o uwzględnieniu biasu w zmiennych

). Pamiętaj o uwzględnieniu biasu w zmiennych  oraz

oraz  . Np. a_1 = [1; a_1].

. Np. a_1 = [1; a_1].

, ustaw:

, ustaw:

:

: